- +1

跟郎朗媳婦有一拼的AI,只看彈琴動作,完美復現原聲

金磊 發自 凹非寺

量子位 報道 | 公眾號 QbitAI

見識過「聽歌識曲」,體驗過看彈奏動作識曲嗎?

就像最近的一檔綜藝節目中,郎朗比劃了幾個彈鋼琴的動作,他媳婦(吉娜·愛麗絲)秒答:《柴可夫斯基第一協奏曲》!

下面便是鋼琴師演奏時的動圖,我們能看到的,僅僅就是手指在鋼琴鍵盤上的變換。

大部分人(或許郎朗級別的大神們可以)應該是猜不到的。

但AI可以,下面便是這項技術復現的原聲音樂。

那么,這般神奇的操作是怎么實現的呢?

三步實現「看動作識音樂」

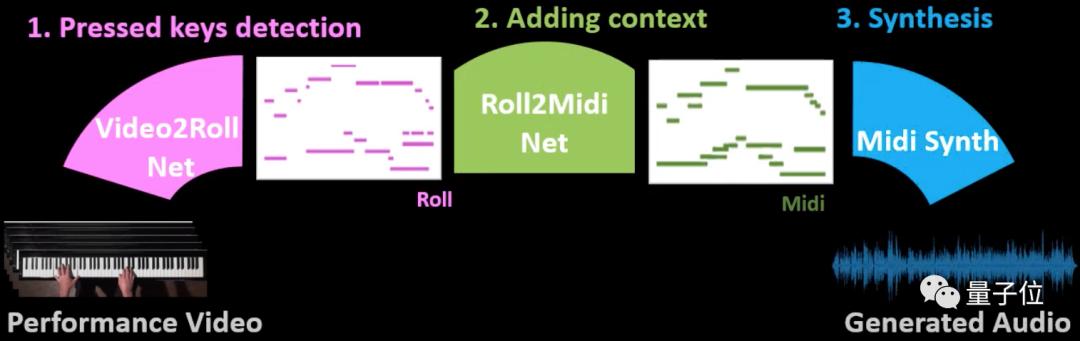

簡單來說,Audeo方法主要包括三大步驟,分別是:

鋼琴按鍵檢測

生成樂譜內容

合成音樂

這個步驟可以理解為一個多標簽(multi一label )分類問題。

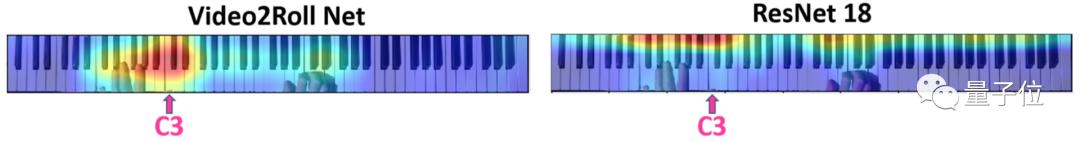

值得注意的是,在這個步驟中,研究人員沒有直接使用ResNet18,而是在此基礎上做了算法改良,提出了Video2Roll Net。

這樣做的原因很簡單,就是ResNet18檢測到的「精度」不夠細致,下面2張熱力圖的對比,便一目了然地展示了2種方法的效果。

在第二個步驟中,就需要將 Roll 轉換為 Midi(樂器數字接口),以便合成音樂。

但在上步生成出來的 roll ,沒辦法直接轉換成 Midi,一個至關重要的原因就是—— Roll 不包含時間信息。

此外,由于 Midi 比較依賴音頻流,所以經常出現的一個現象就是:演奏者按一個鋼琴鍵的時間較長時,相應頻率的幅度會逐漸衰減為零,也就是在 Midi 中會被標記為零。

像下面這張圖中顯示的那樣,就會造成不匹配的現象。

這種不匹配的現象,是經常發生的。

于是,研究人員便提出了一個叫 Roll2Midi Net的方法解決了這個問題。

主要是在二者之間加入了一個生成對抗網絡(GAN),來調節并解決上述問題。

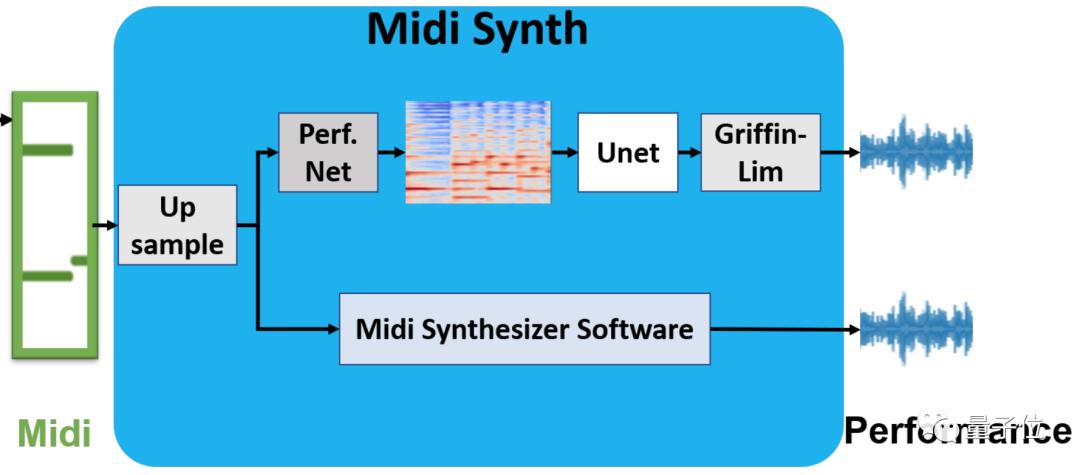

最后一步,就是根據調節好的 Midi 來生成音樂,主要過程如下圖所示。

至于 Audeo 方法與其它方法的定量比較,主要集中在第二個核心步驟。

合成音樂還可以轉換成別的樂器

當然,Audeo 除了精準復現視頻中的鋼琴音樂外,還有一個更有意思的玩法。

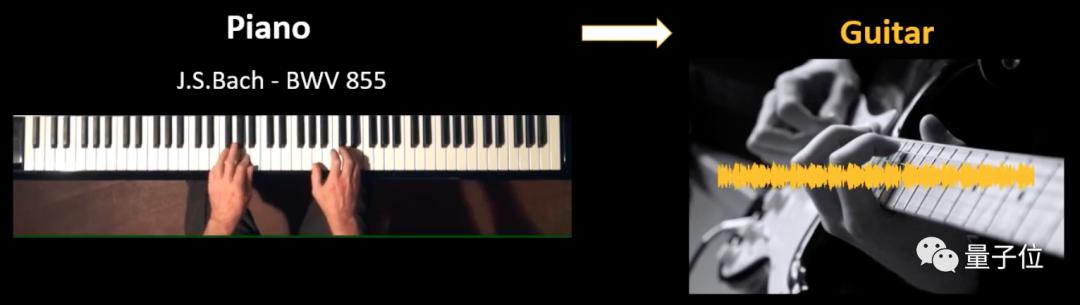

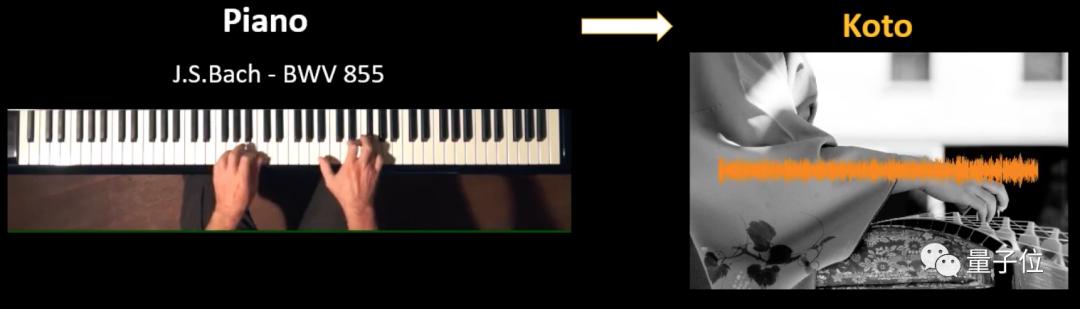

它可以將鋼琴原聲,轉換成其他樂器的聲音。

例如,可以將鋼琴音樂轉換成吉他的聲音。

研究團隊

這項研究由華盛頓大學的三位研究人員共同完成,研究還入圍了本屆CVPR。

論文一作是Kun Su,本科就讀于美國紐約州倫斯勒理工大學(RPI),目前在華盛頓大學攻讀電子與計算機工程系攻讀碩士。

研究的另一位作者是Xiulong Liu,本科在上交大就讀,碩士畢業于華盛頓大學,目前在OneClick.ai 擔任數據科學家。

論文最后一位作者是Eli Shlizerman,華盛頓大學應用數學及電子與計算機工程助理教授。

目前專攻生物神經網絡和人工神經網絡的基本特性,通過結合時空數據分析、機器學習和動力系統理論的方法將這兩個系統聯系起來。

那么問題來了,如果以郎朗的手速彈奏鋼琴,這個AI的效果還會如此驚艷嗎?

論文地址:

https://arxiv.org/abs/2006.14348

作者系網易新聞·網易號“各有態度”簽約作者

— 完 —

原標題:《跟郎朗媳婦有得一拼的AI,只看彈琴動作,完美復現原聲 | CVPR 2020》

本文為澎湃號作者或機構在澎湃新聞上傳并發布,僅代表該作者或機構觀點,不代表澎湃新聞的觀點或立場,澎湃新聞僅提供信息發布平臺。申請澎湃號請用電腦訪問http://renzheng.thepaper.cn。

- 報料熱線: 021-962866

- 報料郵箱: news@thepaper.cn

互聯網新聞信息服務許可證:31120170006

增值電信業務經營許可證:滬B2-2017116

? 2014-2025 上海東方報業有限公司